VS Code 中把「自己部署的 Coder 模型」變成 AI 編程助手

公司內部部署了一個QWen-Coder的7B小模型,這個模型雖然不大,但是驗證后發現效果還不錯。

所以,希望能夠在VS Code中使用這個模型來輔助編寫代碼,這樣就可以避免使用其他付費模型。

1. 安裝插件

在 VS Code 的開源 AI 插件中,Continue 這個插件評價還不錯,功能也能滿足要求:

- 同時支持「對話」和「Tab 自動補全」兩種交互方式

- 后端可接任何兼容 OpenAI API 格式的模型(本地/云端均可)

- 完全離線運行,保護源碼隱私

因此,決定使用此插件來構建AI編程助手。

插件在:https://marketplace.visualstudio.com/items?itemName=Continue.continue

安裝之后,VS Code 的邊欄上會多一個圖標。

2. 配置本地模型

接下來,我們配置它使用我們自己部署的模型:

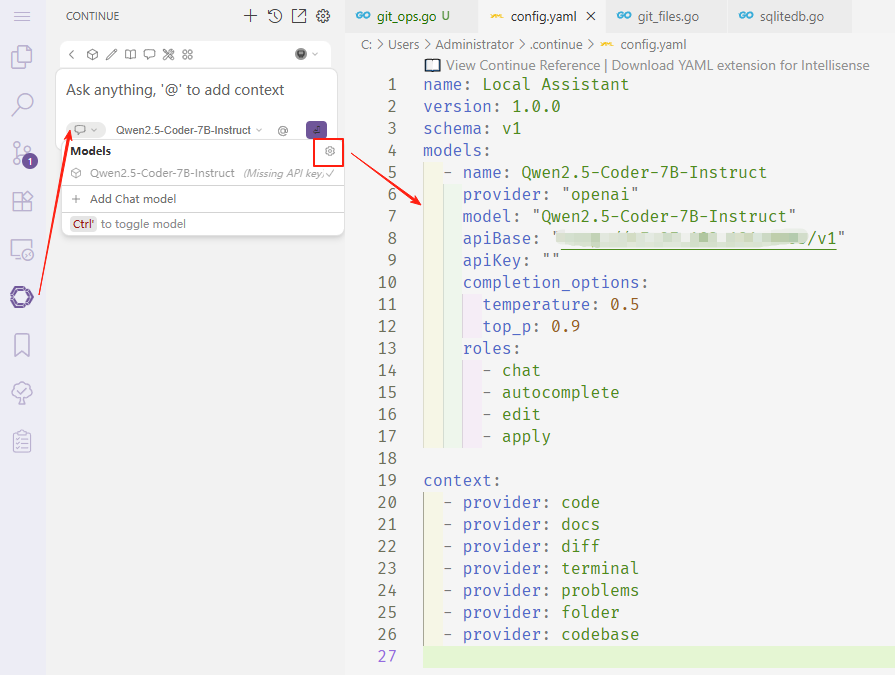

依次點擊左側活動欄上 Continue 圖標 -->選擇Models --> 右上角齒輪。

就可以打開 Continue 的配置文件(yaml格式的),然后參照如上圖的配置。

配置文件中,各個元素的含義如下:

- 基本信息

name: Local Assistant

version: 1.0.0

schema: v1

name: 配置名稱,標識為 "Local Assistant"(本地助手)。version: 配置文件版本(1.0.0)。schema: 使用的配置架構版本(v1)。

- 模型配置

models:

- name: Qwen2.5-Coder-7B-Instruct

provider: "openai"

model: "Qwen2.5-Coder-7B-Instruct"

apiBase: "http://ip:port/v1"

apiKey: ""

completion_options:

temperature: 0.5

top_p: 0.9

roles:

- chat

- autocomplete

- edit

- apply

- 模型定義:使用

Qwen2.5-Coder-7B-Instruct(一個針對代碼任務的7B參數模型)。provider: 設置為"openai",表示兼容OpenAI API格式(這里根據你的實際情況修改)。apiBase: 模型API的終端地址(http://ip:port/v1),指向一個本地或遠程服務。apiKey: 你的模型API密鑰。

- 生成參數:

temperature: 0.5(平衡生成結果的創造性和確定性)。top_p: 0.9(核采樣,限制生成時僅考慮概率最高的90% token)。

- 支持的功能 (

roles):chat: 對話交互。autocomplete: 代碼自動補全。edit: 代碼編輯。apply: 可能指應用代碼更改。

- 上下文集成

context:

- provider: code

- provider: docs

- provider: diff

- provider: terminal

- provider: problems

- provider: folder

- provider: codebase

配置工具可訪問的上下文來源(增強模型對當前任務的理解):

code: 當前編輯的代碼文件。docs: 項目文檔或注釋。diff: 代碼變更差異(如Git diff)。terminal: 終端輸出或命令歷史。problems: 錯誤或警告(如IDE提示)。folder: 當前目錄文件結構。codebase: 整個代碼庫的元信息(如符號定義)。

總得來說,此配置文件定義了一個本地代碼助手,通過HTTP API連接到一個 Qwen2.5-Coder 模型,支持代碼補全、編輯、聊天等功能,并集成了開發環境的多維度上下文(代碼、終端、文檔等)。

3. 驗證效果

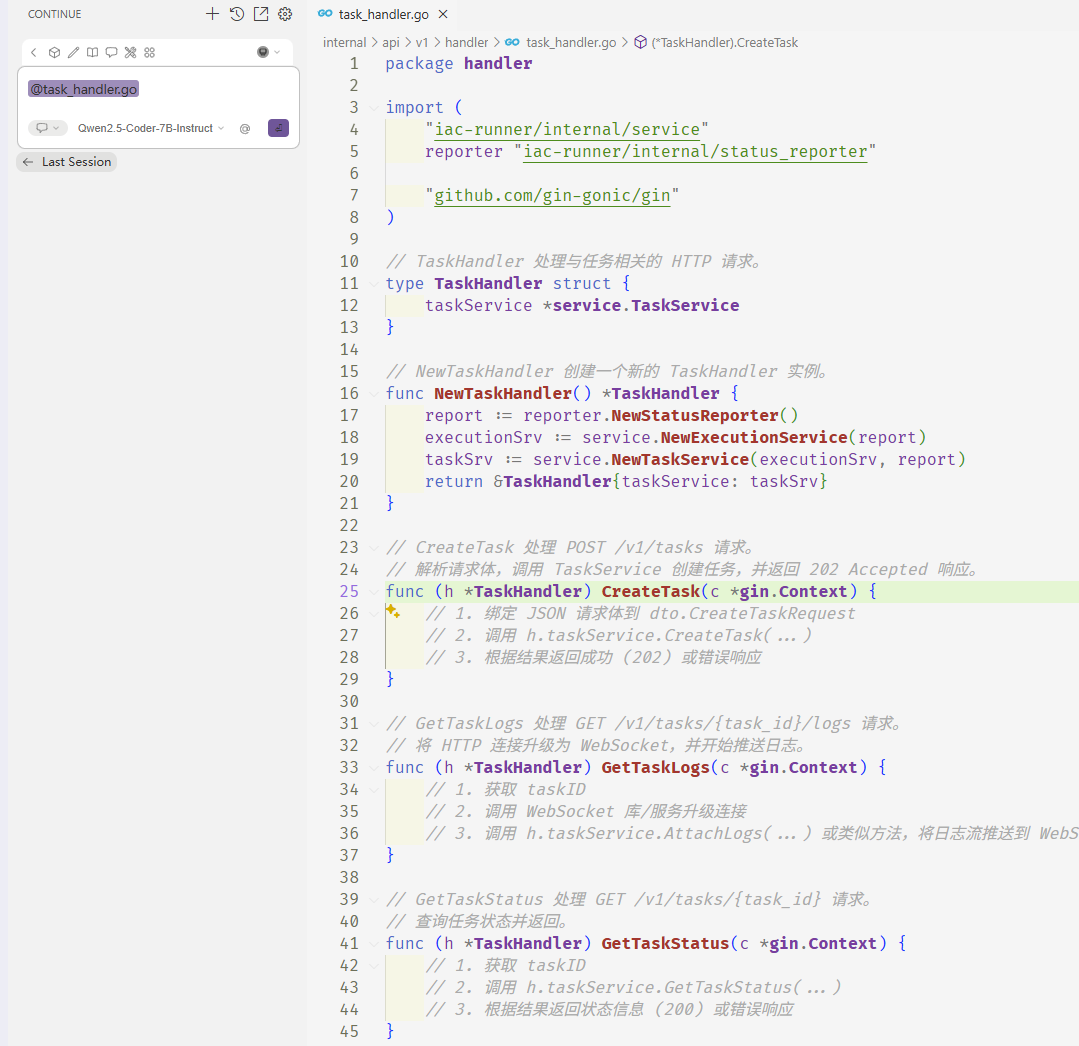

最后,我們來驗證下模型的效果。

首先 **@** 一個代碼文件,下面的示例中是我的一個工程中的代碼:

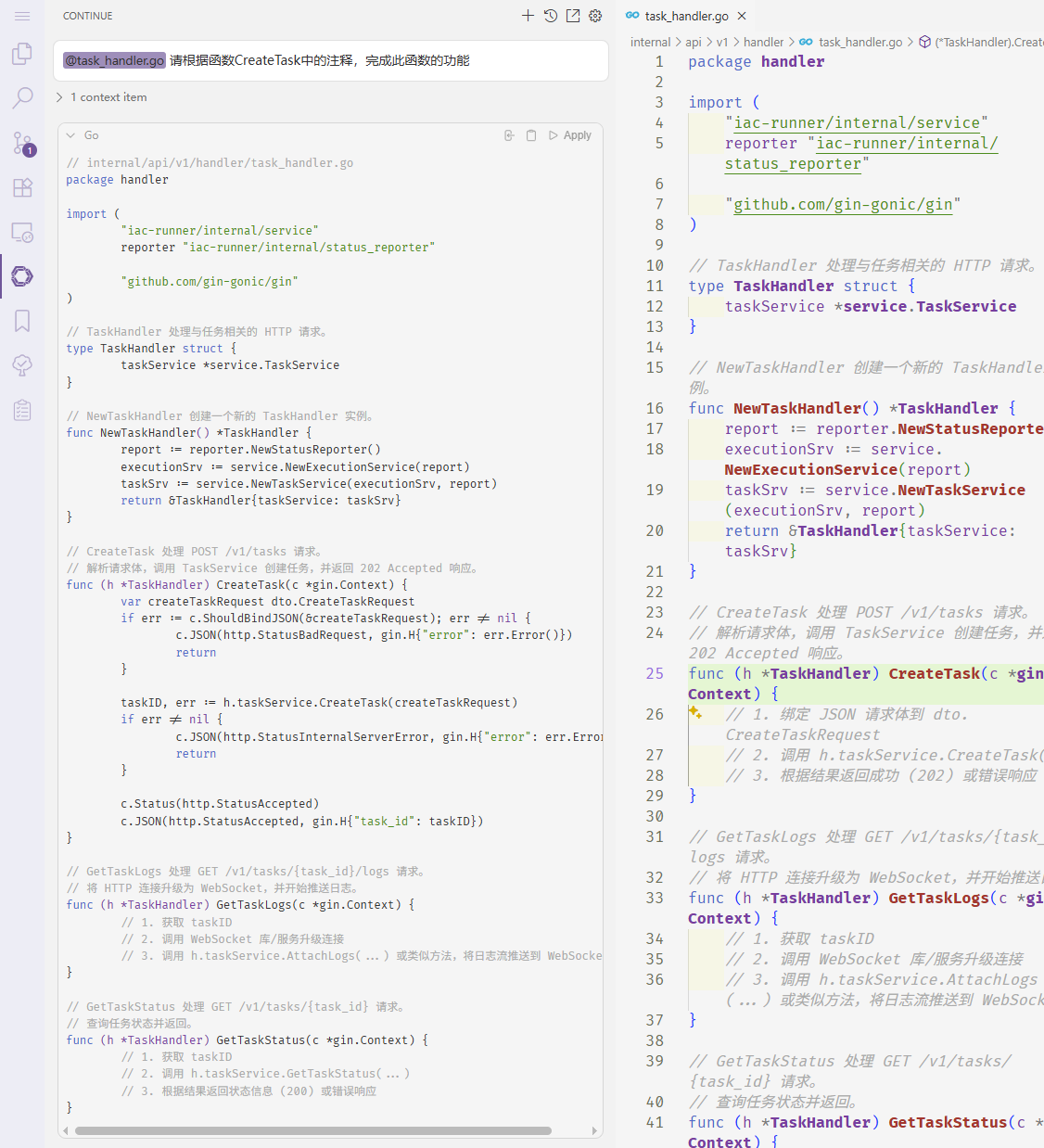

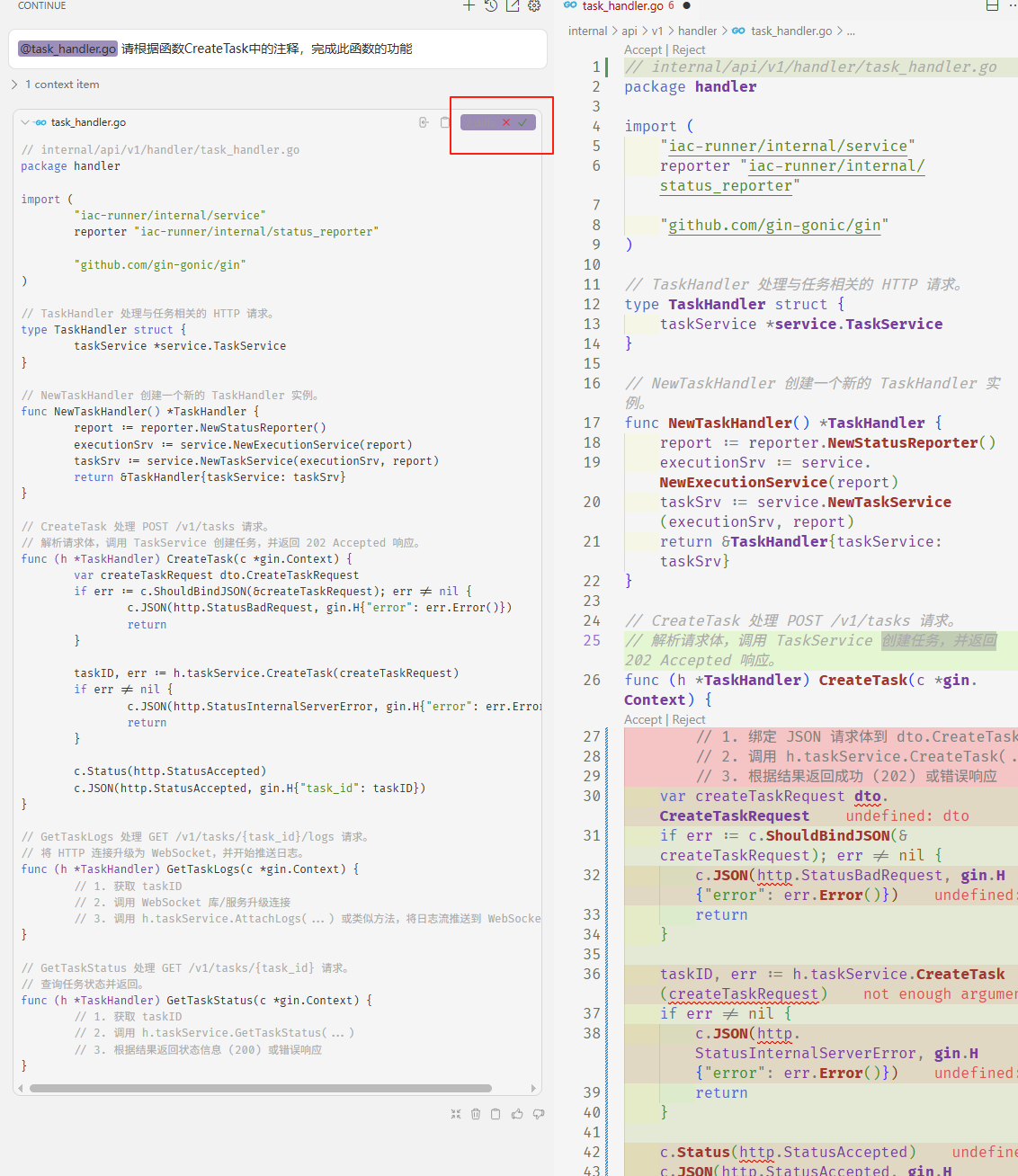

接下來,我們讓AI幫我們生成CreateTask這個函數的代碼:

然后,點擊生成的代碼右上角的 【Apply】按鈕,就能將生成的代碼填充到文件中。

點擊右上角綠色的勾,就能將代碼寫入文件,如果代碼有錯誤,可以繼續通過prompt交互來修改代碼,

或者直接修改代碼文件也行。

4. 總結

十分鐘內,你就能在 VS Code 里用上「完全屬于自己」的 AI 編程助手,既省錢又安心。Happy coding!

浙公網安備 33010602011771號

浙公網安備 33010602011771號