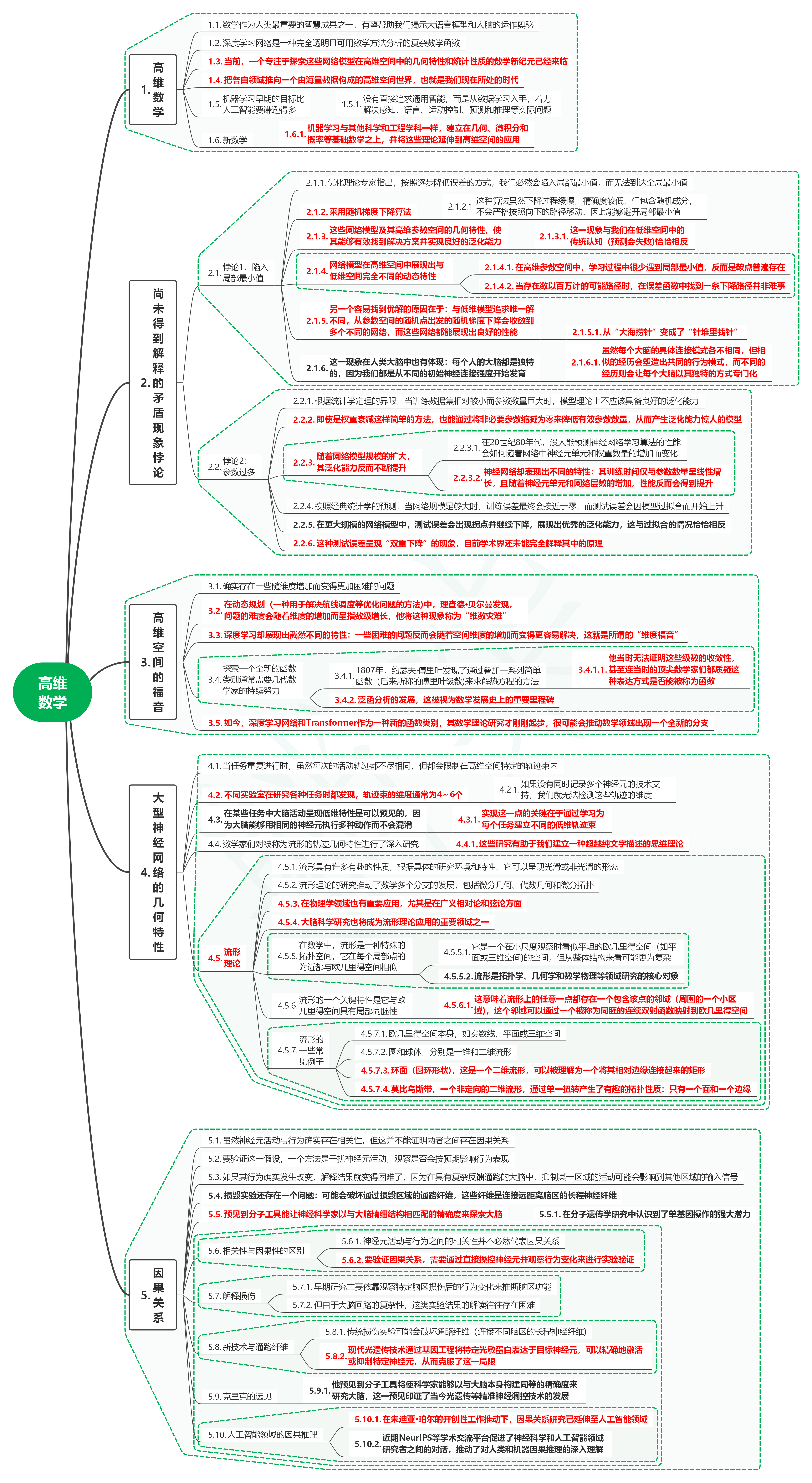

讀大語言模型07高維數學

1. 高維數學

1.1. 數學作為人類最重要的智慧成果之一,有望幫助我們揭示大語言模型和人腦的運作奧秘

1.2. 深度學習網絡是一種完全透明且可用數學方法分析的復雜數學函數

1.3. 當前,一個專注于探索這些網絡模型在高維空間中的幾何特性和統計性質的數學新紀元已經來臨

1.4. 把各自領域推向一個由海量數據構成的高維空間世界,也就是我們現在所處的時代

1.5. 機器學習早期的目標比人工智能要謙遜得多

- 1.5.1. 沒有直接追求通用智能,而是從數據學習入手,著力解決感知、語言、運動控制、預測和推理等實際問題

1.6. 新數學

- 1.6.1. 機器學習與其他科學和工程學科一樣,建立在幾何、微積分和概率等基礎數學之上,并將這些理論延伸到高維空間的應用

2. 尚未得到解釋的矛盾現象悖論

2.1. 悖論1:陷入局部最小值

-

2.1.1. 優化理論專家指出,按照逐步降低誤差的方式,我們必然會陷入局部最小值,而無法到達全局最小值

-

2.1.2. 采用隨機梯度下降算法

-

2.1.2.1. 這種算法雖然下降過程緩慢,精確度較低,但包含隨機成分,不會嚴格按照向下的路徑移動,因此能夠避開局部最小值

-

2.1.3. 這些網絡模型及其高維參數空間的幾何特性,使其能夠有效找到解決方案并實現良好的泛化能力

-

2.1.3.1. 這一現象與我們在低維空間中的傳統認知(預測會失敗)恰恰相反

-

2.1.4. 網絡模型在高維空間中展現出與低維空間完全不同的動態特性

-

2.1.4.1. 在高維參數空間中,學習過程中很少遇到局部最小值,反而是鞍點普遍存在

-

2.1.4.2. 當存在數以百萬計的可能路徑時,在誤差函數中找到一條下降路徑并非難事

-

2.1.5. 另一個容易找到優解的原因在于:與低維模型追求唯一解不同,從參數空間的隨機點出發的隨機梯度下降會收斂到多個不同的網絡,而這些網絡都能展現出良好的性能

-

2.1.5.1. 從“大海撈針”變成了“針堆里找針”

-

2.1.6. 這一現象在人類大腦中也有體現:每個人的大腦都是獨特的,因為我們都是從不同的初始神經連接強度開始發育

-

2.1.6.1. 雖然每個大腦的具體連接模式各不相同,但相似的經歷會塑造出共同的行為模式,而不同的經歷則會讓每個大腦以其獨特的方式專門化

2.2. 悖論2:參數過多

-

2.2.1. 根據統計學定理的界限,當訓練數據集相對較小而參數數量巨大時,模型理論上不應該具備良好的泛化能力

-

2.2.2. 即使是權重衰減這樣簡單的方法,也能通過將非必要參數縮減為零來降低有效參數數量,從而產生泛化能力驚人的模型

-

2.2.3. 隨著網絡模型規模的擴大,其泛化能力反而不斷提升

-

2.2.3.1. 在20世紀80年代,沒人能預測神經網絡學習算法的性能會如何隨著網絡中神經元單元和權重數量的增加而變化

-

2.2.3.2. 神經網絡卻表現出不同的特性:其訓練時間僅與參數數量呈線性增長,且隨著神經元單元和網絡層數的增加,性能反而會得到提升

-

2.2.4. 按照經典統計學的預測,當網絡規模足夠大時,訓練誤差最終會接近于零,而測試誤差會因模型過擬合而開始上升

-

2.2.5. 在更大規模的網絡模型中,測試誤差會出現拐點并繼續下降,展現出優秀的泛化能力,這與過擬合的情況恰恰相反

-

2.2.6. 這種測試誤差呈現“雙重下降”的現象,目前學術界還未能完全解釋其中的原理

3. 高維空間的福音

3.1. 確實存在一些隨維度增加而變得更加困難的問題

3.2. 在動態規劃(一種用于解決航線調度等優化問題的方法)中,理查德·貝爾曼發現,問題的難度會隨著維度的增加而呈指數級增長,他將這種現象稱為“維數災難”?

3.3. 深度學習卻展現出截然不同的特性:一些困難的問題反而會隨著空間維度的增加而變得更容易解決,這就是所謂的“維度福音”?

3.4. 探索一個全新的函數類別通常需要幾代數學家的持續努力

-

3.4.1. 1807年,約瑟夫·傅里葉發現了通過疊加一系列簡單函數(后來所稱的傅里葉級數)來求解熱方程的方法

-

3.4.1.1. 他當時無法證明這些級數的收斂性,甚至連當時的頂尖數學家們都質疑這種表達方式是否能被稱為函數

-

3.4.2. 泛函分析的發展,這被視為數學發展史上的重要里程碑

3.5. 如今,深度學習網絡和Transformer作為一種新的函數類別,其數學理論研究才剛剛起步,很可能會推動數學領域出現一個全新的分支

4. 大型神經網絡的幾何特性

4.1. 當任務重復進行時,雖然每次的活動軌跡都不盡相同,但都會限制在高維空間特定的軌跡束內

4.2. 不同實驗室在研究各種任務時都發現,軌跡束的維度通常為4~6個

- 4.2.1. 如果沒有同時記錄多個神經元的技術支持,我們就無法檢測這些軌跡的維度

4.3. 在某些任務中大腦活動呈現低維特性是可以預見的,因為大腦能夠用相同的神經元執行多種動作而不會混淆

- 4.3.1. 實現這一點的關鍵在于通過學習為每個任務建立不同的低維軌跡束

4.4. 數學家們對被稱為流形的軌跡幾何特性進行了深入研究

- 4.4.1. 這些研究有助于我們建立一種超越純文字描述的思維理論

4.5. 流形理論

-

4.5.1. 流形具有許多有趣的性質,根據具體的研究環境和特性,它可以呈現光滑或非光滑的形態

-

4.5.2. 流形理論的研究推動了數學多個分支的發展,包括微分幾何、代數幾何和微分拓撲

-

4.5.3. 在物理學領域也有重要應用,尤其是在廣義相對論和弦論方面

-

4.5.4. 大腦科學研究也將成為流形理論應用的重要領域之一

-

4.5.5. 在數學中,流形是一種特殊的拓撲空間,它在每個局部點的附近都與歐幾里得空間相似

-

4.5.5.1. 它是一個在小尺度觀察時看似平坦的歐幾里得空間(如平面或三維空間)的空間,但從整體結構來看可能更為復雜

-

4.5.5.2. 流形是拓撲學、幾何學和數學物理等領域研究的核心對象

-

4.5.6. 流形的一個關鍵特性是它與歐幾里得空間具有局部同胚性

-

4.5.6.1. 這意味著流形上的任意一點都存在一個包含該點的鄰域(周圍的一個小區域),這個鄰域可以通過一個被稱為同胚的連續雙射函數映射到歐幾里得空間

-

4.5.7. 流形的一些常見例子

-

4.5.7.1. 歐幾里得空間本身,如實數線、平面或三維空間

-

4.5.7.2. 圓和球體,分別是一維和二維流形

-

4.5.7.3. 環面(圓環形狀),這是一個二維流形,可以被理解為一個將其相對邊緣連接起來的矩形

-

4.5.7.4. 莫比烏斯帶,一個非定向的二維流形,通過單一扭轉產生了有趣的拓撲性質:只有一個面和一個邊緣

5. 因果關系

5.1. 雖然神經元活動與行為確實存在相關性,但這并不能證明兩者之間存在因果關系

5.2. 要驗證這一假設,一個方法是干擾神經元活動,觀察是否會按預期影響行為表現

5.3. 如果其行為確實發生改變,解釋結果就變得困難了,因為在具有復雜反饋通路的大腦中,抑制某一區域的活動可能會影響到其他區域的輸入信號

5.4. 損毀實驗還存在一個問題:可能會破壞通過損毀區域的通路纖維,這些纖維是連接遠距離腦區的長程神經纖維

5.5. 預見到分子工具能讓神經科學家以與大腦精細結構相匹配的精確度來探索大腦

- 5.5.1. 在分子遺傳學研究中認識到了單基因操作的強大潛力

5.6. 相關性與因果性的區別

-

5.6.1. 神經元活動與行為之間的相關性并不必然代表因果關系

-

5.6.2. 要驗證因果關系,需要通過直接操控神經元并觀察行為變化來進行實驗驗證

5.7. 解釋損傷

-

5.7.1. 早期研究主要依靠觀察特定腦區損傷后的行為變化來推斷腦區功能

-

5.7.2. 但由于大腦回路的復雜性,這類實驗結果的解讀往往存在困難

5.8. 新技術與通路纖維

-

5.8.1. 傳統損傷實驗可能會破壞通路纖維(連接不同腦區的長程神經纖維)

-

5.8.2. 現代光遺傳技術通過基因工程將特定光敏蛋白表達于目標神經元,可以精確地激活或抑制特定神經元,從而克服了這一局限

5.9. 克里克的遠見

- 5.9.1. 他預見到分子工具將使科學家能夠以與大腦本身構建同等的精確度來研究大腦,這一預見印證了當今光遺傳等精準神經調控技術的發展

5.10. 人工智能領域的因果推理

-

5.10.1. 在朱迪亞·珀爾的開創性工作推動下,因果關系研究已延伸至人工智能領域

-

5.10.2. 近期NeurIPS等學術交流平臺促進了神經科學和人工智能領域研究者之間的對話,推動了對人類和機器因果推理的深入理解

浙公網安備 33010602011771號

浙公網安備 33010602011771號