樹莓派5安裝ollama+open-webui

新購置了個PI5,就想著折騰些什么。除了給它裝codesys之外,想到(尤其是看到官配的冷卻風扇)是不是能跑個AI什么的。捜了一下,除了TensorFlow Lite、PyTorch Mobile還有做視覺的OPENCV和YOLO。除此之外,一個熟悉的詞匯又冒了出來。ollama。記得有段時間看到很多短視頻推送,想著就找下資料看下。

ollama

由于之前全局安裝node-red遇到npm的各種問題,想著“為吃烤鴨配一套爐子”,所以就直接選擇的docker。

ollama docker

事實證明,docker確實香。

直接按照網(wǎng)站內(nèi)容

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

記得如果權(quán)限問題deny了你permission denied...,記得最前面加sudo。

然后就是等待。

由于docker官方倉庫一直處于timeout狀態(tài),于是“翻了下筆記”,然后直接選了個倉庫下載。

$ sudo docker pull docker.m.daocloud.io/ollama/ollama

很順利,一會兒就成功了。

$ sudo docker images

REPOSITORY TAG IMAGE ID CREATED SIZE

ghcr.io/open-webui/open-webui main 1496175979b3 20 hours ago 4.2GB

docker.m.daocloud.io/ollama/ollama latest 318ba808b989 10 days ago 3.28GB

然后把這個鏡像run起來。

$ sudo docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama docker.m.daocloud.io/ollama/ollama

然后,發(fā)現(xiàn)就成了。

但使用時候,似乎是需要exec進ollama的容器里面操作。

所以,后續(xù)又嘗試了。

$ sudo docker exec -it ollama bash

然后通過ollama拉取大語言模型。

模型倉庫

已開始拉的是llama2,完成之后

$ollama run llama2

告知我內(nèi)存不足,需要8G內(nèi)存,8G的PI5和只有7.6G。

同時,學(xué)習(xí)到,運行所需的內(nèi)存大致是模型的1.2倍,于是找了幾個小點的。

root@7c4f600436ec:/# ollama ls

NAME ID SIZE MODIFIED

qwen2.5-coder:1.5b 7088ac567b1e 986 MB 2 hours ago

qwen2.5:3b 357c53fb659c 1.9 GB 3 hours ago

qwen2.5:1.5b 65ec06548149 986 MB 3 hours ago

qwen2.5:0.5b a8b0c5157701 397 MB 6 hours ago

llama3.2:latest a80c4f17acd5 2.0 GB 2 hours ago

然后run了一下。

root@7c4f600436ec:/# ollama run qwen2.5:3b

>>> 你好,介紹下你自己!

你好!我是Qwen,是由阿里云開發(fā)的語言模型。我被設(shè)計為幫助用戶獲得準確、有用的信息和解答他們的問題。我的知識涵蓋廣泛的領(lǐng)域,包括科學(xué)、技術(shù)、藝術(shù)以及歷史等。

我可以回答各種問題,并在需要時提供建議和支持。同時,我也致力于保護個人隱私和安全。

盡管我是基于大規(guī)模預(yù)訓(xùn)練模型構(gòu)建的,但我始終遵循阿里云制定的內(nèi)容準則與倫理標準,在任何情況下都不會發(fā)布或傳播不實信息或非法內(nèi)容。我努力成為一個可靠且值得信

賴的語言模型助手。

>>>

發(fā)現(xiàn)跑起來了。興奮之余,開始覺得不滿足。每次都要進docker是不是有點操作不便,而且,不利于分享嘛。

于是乎,又找來了open-webui。

open-webui

首頁直接說Quick Start with Docker ?? (Recommended)

于是我就直接

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

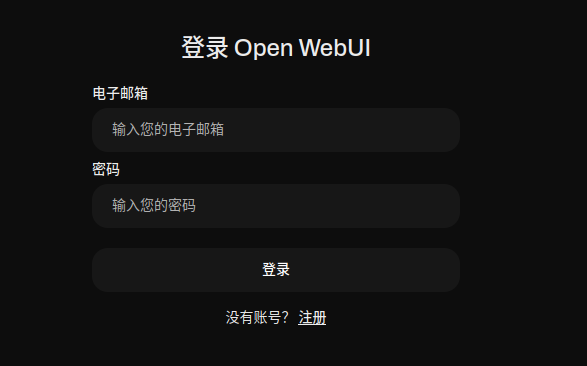

然后,按照說明,打開瀏覽器,輸入<ip>:3000。

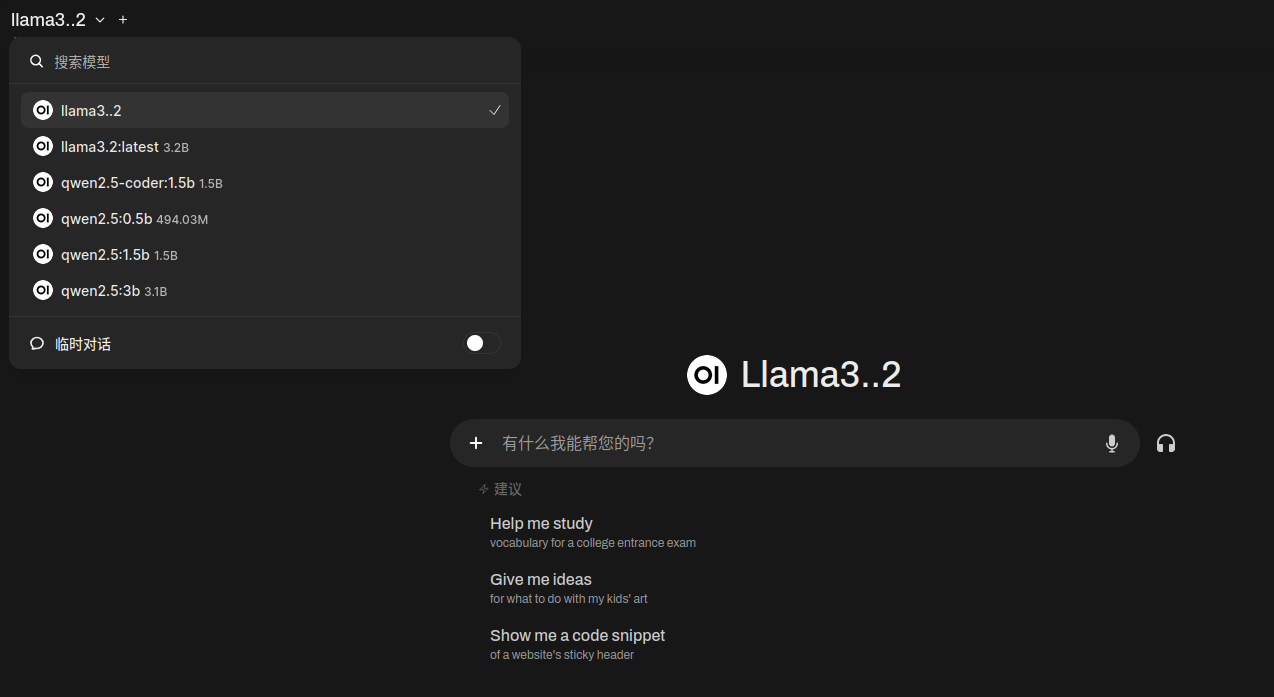

然后注冊,登陸,左側(cè)可以選擇AI。

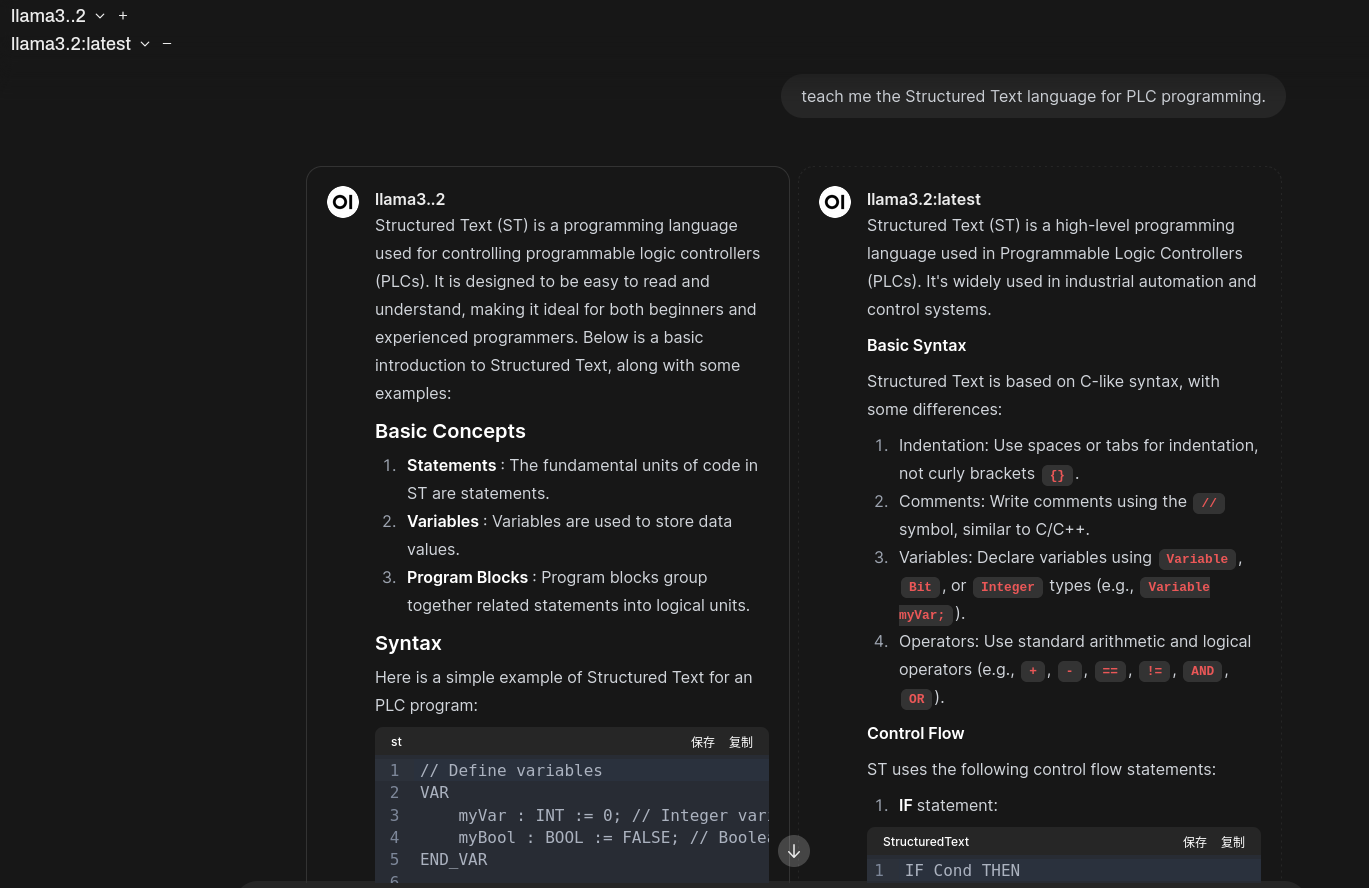

然后發(fā)現(xiàn),居然可以同時調(diào)戲多個AI。

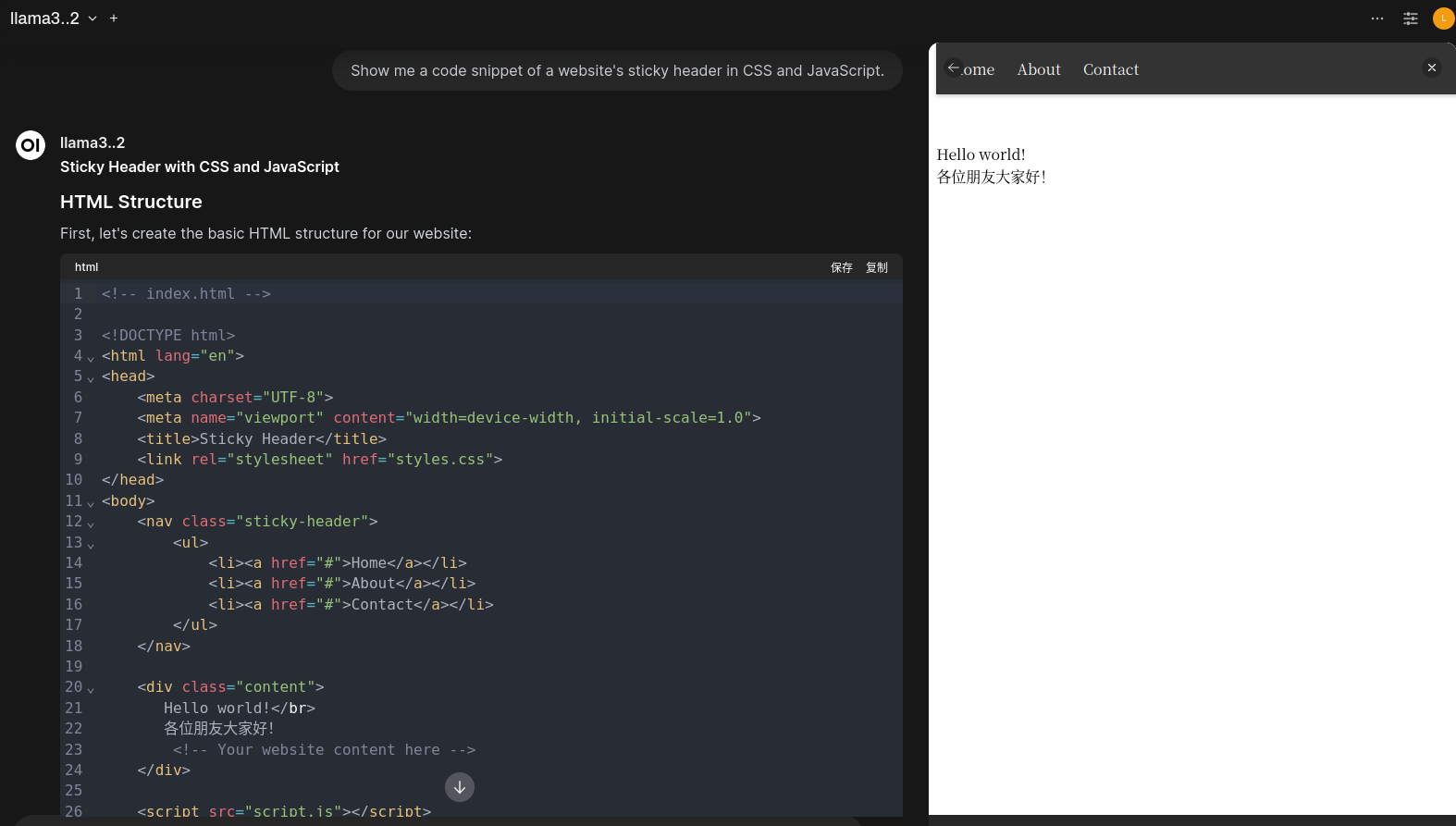

寫了html代碼還可以直接顯示,還能修改之后再顯示。

實在是很帥阿!

于是,曬給同事玩。

發(fā)現(xiàn),注冊后無法登陸

然后找了好一會兒,找到在管理員面板->儀表盤,找到新注冊的用戶信息,然后給他用戶權(quán)限。

再摸索了一下,發(fā)現(xiàn)還有好些功能沒有用到,今天先到這兒了,其余留著慢慢研究吧!

浙公網(wǎng)安備 33010602011771號

浙公網(wǎng)安備 33010602011771號